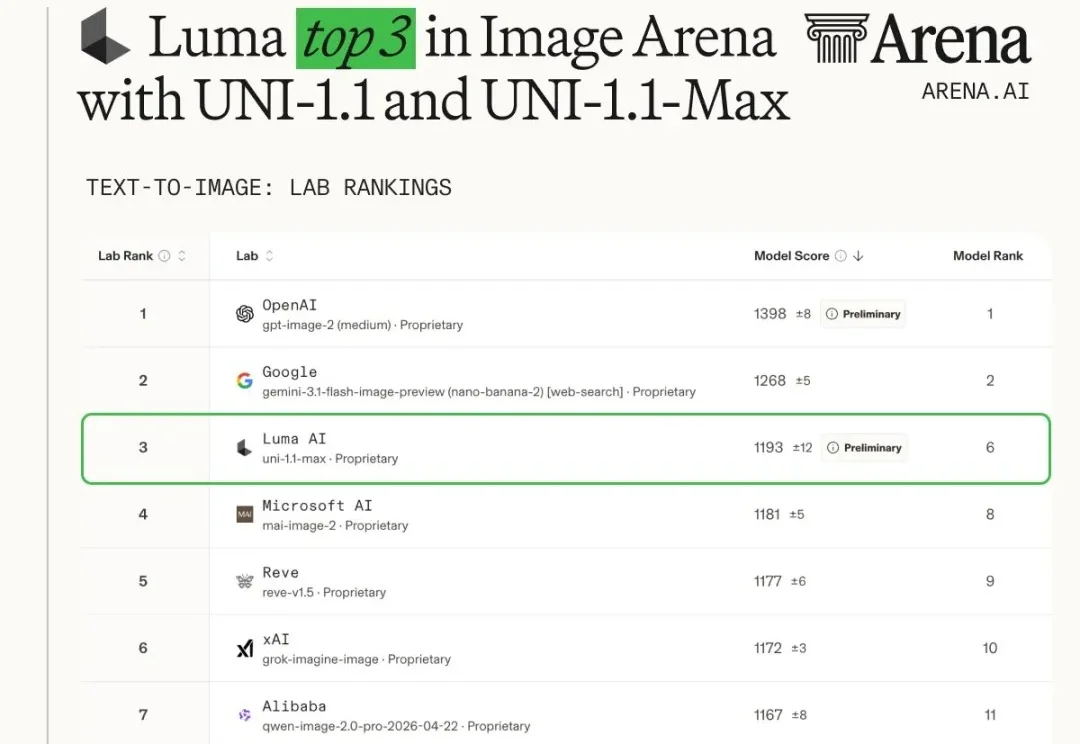

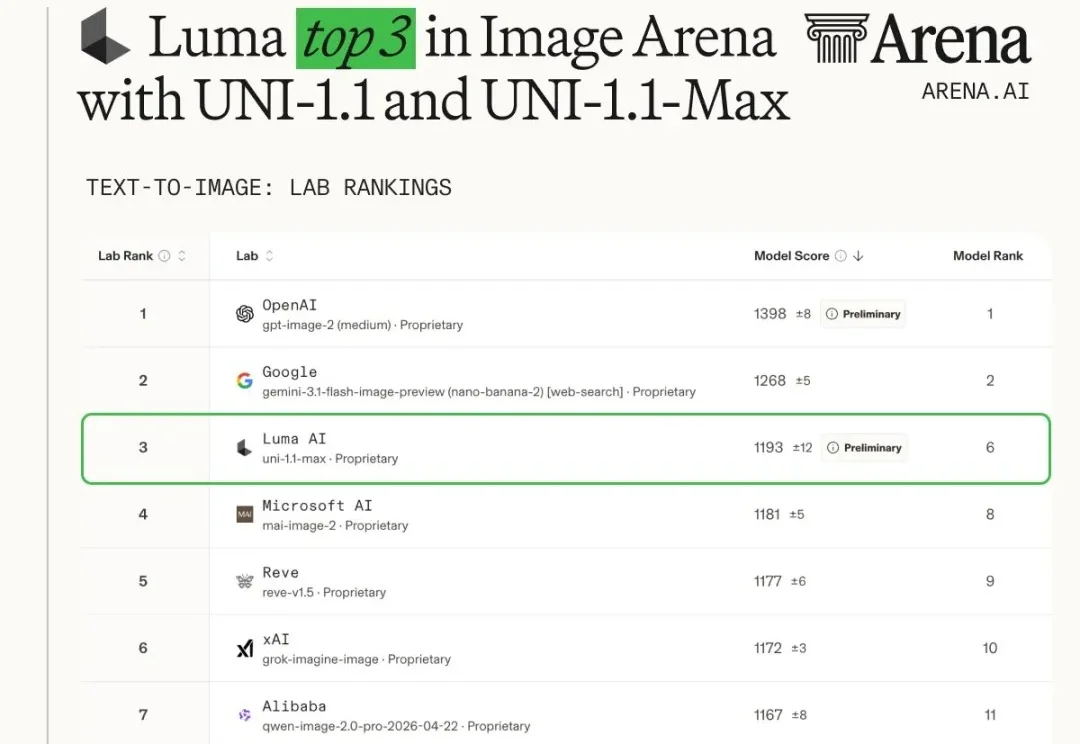

Luma Uni-1.1 API开放,图像模型榜单第三,文字渲染直逼GPT image 2

Luma Uni-1.1 API开放,图像模型榜单第三,文字渲染直逼GPT image 2今年以来,图像生成模型的迭代节奏明显加快。

搜索

搜索

今年以来,图像生成模型的迭代节奏明显加快。

GPT Image 2 凭什么这么强?是扩散模型又迭代了一版?是把 DiT 的参数量从 7B 扩到 20B?是训了更多高质量数据?先给结论:OpenAI 很可能已经不在“纯扩散模型”这条主赛道上了。他们已经把图像生成从“美术课”调到了“语文课”——用一个能读懂指令、能记住上下文、能理解物体关系的 LLM 主导语义规划,至于最后一步的像素生成,可能由扩散组件或其他解码器完成。

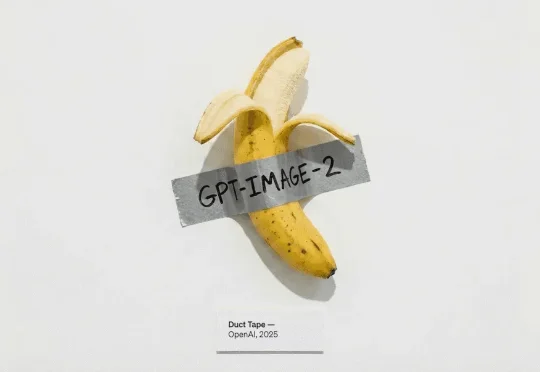

GPT Image 2的发布给整个AI圈带来了亿点点震撼。但很多人可能没注意到,幕后最会玩梗的居然是他——主力训练者陈博远。他和奥特曼同台主持,悄悄修好了中文渲染;给模型起代号“布基胶带”,还拿香蕉艺术品玩梗;为了秀模型的文字能力,设计了米粒刻字、漫画套娃、视觉证明题这些“彩蛋级”测试。

SenseNova U1 是商汤最新发布的一个开源的多模态模型,它的 Lite 系列 8B 和 A3B 参数版本,目前已经在 Hugging Face 和 GitHub 上开源。APPSO 也提前拿到了测试资格,我们发现商汤这款新一代原生理解生成统一模型,就开源模型来说,已经做到了最好水平。

GPT Image2全网刷屏,但效果究竟为什么这么好?

这两周国内外的 AI 圈又开始密集更新了。 上周 Anthropic 发了 Opus 4.7,这周 OpenAI 上了 GPT Image 2。国内这边 Kimi 发了 K2.6,腾讯据说也要发一个模

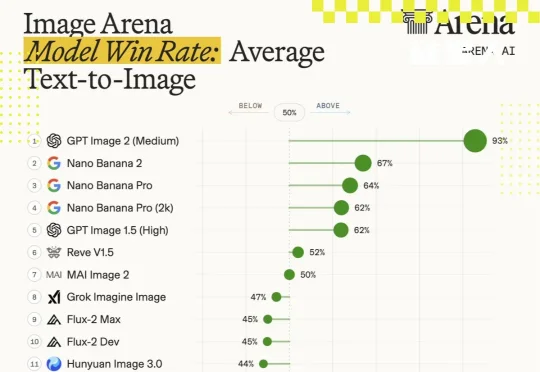

GPT Image 2的横空出世,直接暴打 Nano Banana 2,现在,真假难辨的照片和梗图已经满天飞了。超强的文字渲染和封神的设计能力,直接让它颠覆了众多行业,这一刻起,互联网的信任体系彻底洗牌!

使用 GPT Image 2 甚至不太需要过于复杂的提示词,我们的测试都是一两句简单的画面描述,或者再加上图片尺寸要求,如 21:9、16:9、9:16 等。 例如让它生成广州市小学数学试卷。

4 月初,LM Arena 评测平台上出现了三个匿名图像模型,代号分别是 maskingtape-alpha、packingtape-alpha、gaffertape-alpha。几小时后它们消失了。OpenAI 官方还没有正式宣布这个模型,但根据 API 返回的元数据和用户侧的测试记录,它已经有了一个被广泛接受的名字:GPT Image 2。

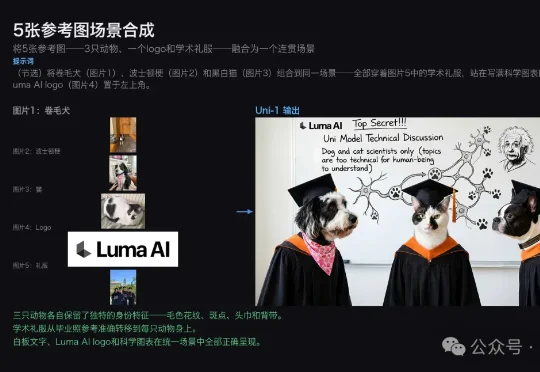

刚刚,Luma AI甩出全新模型Uni-1,正面对标谷歌Nano Banana Pro和GPT Image 1.5。Uni-1是一个统一的图像理解与生成模型。在官方展示中,Uni-1具备角色姿态迁移、故事板生成、草稿+材质结合参考生成、草稿转漫画、多参考图场景合成、草稿引导的照片编辑、UV贴图生成、带有文字的贺卡海报生成等诸多能力。